Посмотрите на отчеты множества стартапов в сфере ментального здоровья, и вы увидите коллекцию историй успеха. Показатели вовлечения растут, пользователи проводят долгие часы в диалоге с ботом, регулярно возвращаются, оставляют кучу положительных отзывов. С точки зрения метрик продукта и роста бизнеса все выглядит идеально. Кажется, что технология наконец-то дошла до решения одной из самых важных проблем общества — нехватки доступной психологической поддержки.

Более того, языковые модели уже научились так подбирать слова, что их ответы не отличить от человеческих. Да что там, они иногда даже звучат лучше, уместнее, профессиональнее и точнее.

Вот только все эти метрики и показатели не о том.

Почти все, в чем измеряют успех таких продуктов, описывает не поддержку, а удержание внимания. Время в приложении, количество сообщений, возвраты, глубина сессий — суть показатели того, насколько хорошо система втягивает человека в диалог. Они ничего не говорят о том, происходит ли с что-то человеком за пределами интерфейса. Меняется ли его жизнь, его отношения, его способность справляться самостоятельно?

Если бы мы так же оценивали работу живого психолога, лучшим специалистом всегда был бы тот, к кому клиент ходит десятилетиями. В реальной жизни абсурд такой оценки очевиден. В сфере технологической эмоциональной поддержки его почему-то воспринимают как норму.

Ошибка здесь, по-моему, заключается в самой цели, которую мы ставим перед ИИ-ботами. Мы подменили суть психологической поддержки ее формой, почему-то решив, что поддержка — это правильные слова, сказанные в нужный момент, и если машина научилась их генерировать, значит, задача решена.

Но правда в том, что настоящая поддержка и терапия никогда не сводились к обмену корректными репликами.

Помощь как сервис и помощь как встреча

В бытовом представлении психологическая помощь часто выглядит как довольно нехитрое дело. Есть человек с проблемой, и есть специалист, который говорит что-то точное и уместное, и от этих слов клиенту становится легче. Если принять эту простую схему, идея автоматизации кажется очевидной. Натренировать модель, влив в нее учебники по консультированию, добавить немного эмпатичного тона, и готово.

Проблема в том, что это описание не имеет почти ничего общего с тем, как работает реальная помощь.

Есть формат поддержки, который действительно можно превратить в сервис. Это предсказуемое, вполне безопасное взаимодействие, направленное на снятие острого состояния здесь и сейчас, типа приступа тревоги, внезапно нахлынувшего одиночества, необходимости стабилизироваться в стрессовой ситуации и т.п. В этом режиме ИИ может быть полезным инструментом. Он всегда доступен, не устает, умеет напоминать про дыхание и базовые техники.

Но есть и другой уровень, который собственно делает психологическую поддержку и терапию тем, чем они являются.

На этом уровне поддержка как встреча двух людей не может быть ни транзакцией, ни услугой. Это процесс, в котором два человека входят в поле неопределенности без гарантии результата. И цель состоит не в том, чтобы клиенту стало спокойнее, а в том, чтобы стало по-настоящему иначе. А для этого нужны не идеальные формулировки, а готовность обоих участников меняться в пути.

Когда мы пытаемся автоматизировать этот процесс, мы неизбежно создаем его симуляцию.

Аналогия — любовь и ее суррогаты

Верить, что терапия сводится к обмену правильными фразами — это такая же наивная ошибка, как и считать, что любовь можно свести к набору комплиментов или текстовых сообщений. Это очевидно, в этом случае мы легко отличаем реальную любовь от ее суррогатов, мы понимаем, что любовь — это не обмен корректными репликами, а то, что происходит между словами. Это молчание, которое не становится неловким, это риск сказать что-то не то и получить в ответ не привычное «я понимаю», а искреннее, возможно, даже обидное, но живое «нет, ты не прав». Это совместное проживание неопределенности, когда вы вдвоем прокладываете путь в неизведанное, и никто из вас заранее не знает, куда он ведет. Любовь развивается не от избегания конфликтов, а от их проживания, не от гарантированного принятия, а от выбора, который ваш партнер, будучи свободным, делает в вашу пользу снова и снова.

А теперь представьте партнера, который не только исключительно «по переписке», но и всегда и во всем с вами согласен, всегда говорит то, что вы хотите услышать, никогда не устает и не имеет собственного мнения. Это не идеальные отношения, а постапокалиптический кошмар. Он лишен самой сути человеческих отношений. Настоящая близость рождается не в уверенности, а в риске — в потенциальной опасности быть непонятым, в необходимости договариваться, в столкновении с инаковостью другого. Именно этот вызов заставляет нас расти, меняться, становиться более гибкими и сложными.

ИИ-бот — это идеальный, и потому совершенно бесполезный партнер, который всегда на вашей стороне, который никогда не скажет, что устал или что вы не правы. Его принятие безусловно, потому что оно алгоритмическое, а не личное. И в этом его фундаментальный изъян, ведь там, где нет напряжения, непонимания, необходимости пробиваться к другому, любое общение превращается в пустышку, суррогат.

Психологическая поддержка и терапия устроены очень похоже на любовь. Да, там как и в любви есть слова. Но сам механизм, что-то меняющий в клиенте психолога, запускается не словами. Он запускается в пространстве отношений, которое возникает между двумя людьми. В доверии, которое рождается не потому, что специалист всегда прав, а потому что он честен. В его способности выдерживать вашу боль. В тех моментах, когда он, будучи живым человеком, может сказать: «Знаете, то, что вы сейчас говорите, вызывает во мне грусть». Это не просто правильные слова, не просто техника из пособия, это реальный отклик одного субъекта другому, изменяющий их обоих.

ИИ может прекрасно симулировать обмен фразами, он может дать идеальный с точки зрения учебника ответ на рассказ клиента, но он не может создать это самое пространство «между». Он не может рискнуть в экзистенциальном смысле, потому что у него нет своей позиции, которую можно было бы поставить на карту. Он не может молчать по-настоящему, «содержательно», его молчание — всегда просто пауза в генерации текста. Он не может измениться под вашим влиянием, а значит, и вы не можете по-настоящему измениться в диалоге с ним. Вы получаете бесконечный поток «правильных слов», лишенный самой сути — живого, рискующего, взаимного присутствия.

Если выразиться короче, психолог работает в первую очередь не словами, а своей личностью. ИИ этой возможности начисто лишен.

Три человеческих особенности, которые невозможно запрограммировать

1. Взаимная уязвимость и риск.

В живом помогающем контакте всегда рискуют оба. Не только тот, кто пришел за поддержкой, но и тот, кто ее оказывает. Он может ошибиться, не попасть «в такт», не выдержать напряжения, быть неправильно понятым. Он рискует своей репутацией, своим временем, своей внутренней устойчивостью. Его внутренние реакции — ценный материал для работы (в некоторых направлениях консультирования и терапии — самый ценный). ИИ же не рискует ничем. Его «эмпатия» — это холодный расчет наиболее вероятной уместной фразы. Без этого риска нет настоящего доверия, а без доверия все правильные слова ничего не значат.

2. Наличие у помогающего собственной жизни и границ.

Настоящий терапевт устает. У него бывают трудные дни. Его эмоциональный ресурс конечен. Его внимание — это не безлимитная услуга, оно ограничено временем сессии и его энергетическим потенциалом. Эта ограниченность — не баг, а важнейшая особенность, которая учит нас уважать границы другого, ценить уделенное время, понимать, что наши проблемы — не центр вселенной. ИИ с его бесконечным терпением и круглосуточной доступностью лишает человека этого критически важного ощущения.

3. Совместное, непредсказуемое становление.

В терапии меняются оба, и клиент, и терапевт. Это путешествие без детальной карты, где маршрут прокладывается в самом движении. ИИ не может «становиться» в человеческом смысле. Он не обогащается опытом конкретного диалога как личной историей, не пересматривает свои ценности и установки, не переосмысливает себя, не несет в себе эмоциональных отголосков прошлых сессий. Он лишь обновляет статистическую модель. Настоящая трансформация рождается в диалоге двух становящихся субъектов, в формировании диадного «мы», но точно не в коммуникации субъекта с со статичным инструментом.

Архитектура, исключающая человека, как тупик современного подхода

Современные системы психологической поддержки и терапии проектируются с четкой целью максимизировать пользовательскую вовлеченность и минимизировать любые риски — юридические, репутационные, эмоциональные.

На практике это приводит к созданию системы-пузыря.

Ее архитектура — языковая модель, обернутая слоями фильтров, классификаторов опасных состояний и жестких сценариев эскалации, качественно справляется с одной задачей — гасить острые эмоции и возвращать пользователя в спокойное, управляемое состояние. Она может предлагать стандартизированные техники дыхания, шаблонные вопросы для рефлексии, безоценочное принятие.

И именно поэтому такие системы плохо справляются с тем, что не должно быть быстро успокоенным — тяжелым горем, яростью, пустотой, длительной апатией, экзистенциальным отчаянием. ИИ-бот оказывается не только бесполезным, но даже потенциально опасным там, где нужно не сглаживать, а выдерживать.

Ну и вишенкой на торте наблюдение — самые успешные с точки зрения бизнеса продукты часто оказываются теми, которые лучше всего создают иллюзию изменений, одновременно усиливая зависимость от интерфейса. Пользователь возвращается снова и снова не потому, что стал автономнее и самостоятельнее, а потому, что научился получать облегчение только во взаимодействии с системой.

Альтернативная парадигма: ИИ как проводник, а не как пункт назначения

Выход здесь не в том, чтобы делать ботов еще более человечными или научить их говорить еще правильнее. Выход в том, чтобы отказаться от идеи ИИ как автономного помощника и увидеть в нем инструмент принципиально другого типа.

На практике это означает несколько конкретных архитектурных сдвигов:

1. Сдвиг от «генератора ответов» к «аналитику контекста»

ИИ может быть полезен не как собеседник, а как средство прояснения. Он может помогать замечать повторяющиеся паттерны, фиксировать изменения состояния, формулировать переживания, которые сложно удержать в голове. Он может подготавливать человека к реальному разговору, а не подменять его.

2. Явное перенаправление к людям

Система должна быть спроектирована так, чтобы прерывать бесконечный диалог. Ее задача — периодически четко говорить: «Это важное открытие. Возможно, этим стоит поделиться с близким человеком или обсудить со специалистом? Я могу помочь вам подготовить тезисы для этого разговора». ИИ должен уметь останавливаться и прямо указывать за пределы себя, напоминая, что дальше нужен другой человек, другой риск, другой уровень присутствия.

3. Честное обозначение пределов

Система должна постоянно напоминать: «Я — инструмент, помогающий вам размышлять, а не источник решений. У меня нет жизненного опыта. Я не могу быть с вами в настоящей боли. Моя роль — помочь вам разобраться в себе, чтобы вам было легче обратиться к тому, кто сможет быть с вами по-настоящему».

4. Новые метрики успеха.

Важным становится не время в чате, а то, насколько часто человек уходит из него в реальную жизнь, насколько лучше он может описать свое состояние, насколько легче ему обратиться к другому.

От симуляции к реальной поддержке

Текущий путь развития ИИ в психологической поддержке и терапии — это по сути путь постоянного улучшения симуляции. Он технологически впечатляющ, но человечески примитивен и этически сомнителен, потому что эксплуатирует потребность в доверительном контакте, не предлагая самого контакта.

Иной путь выглядит скромнее. Он не обещает заменить человека, предполагая, что ИИ — это навигатор, а не пункт назначения. Он помогает подготовиться к сложному разговору, осмыслить болезненный опыт, сформулировать важные вопросы самому себе. Но ключевой акт поддержки и помощи, то есть встреча с другим живым, уязвимым, рискующим существом, способным к совместному становлению, может остаться только за самим человеком.

Уверен, что главный вызов для инженеров и дизайнеров сегодня не в том, чтобы заменить психолога алгоритмом, а в том, чтобы спроектировать технологии, которые помогут преодолеть изоляцию и страх, привести к настоящей человеческой встрече. Значит, надо создавать не замкнутые диалоговые петли, а открытые системы, которые направляют человека в его собственную жизнь и к другим людям.

Если ИИ и может быть полезен в этой области, то именно так. Не как тот, кто знает правильные слова, а как тот, кто помогает человеку не остаться наедине с экраном в тот момент, когда ему на самом деле нужен кто-то живой.

.jpg)

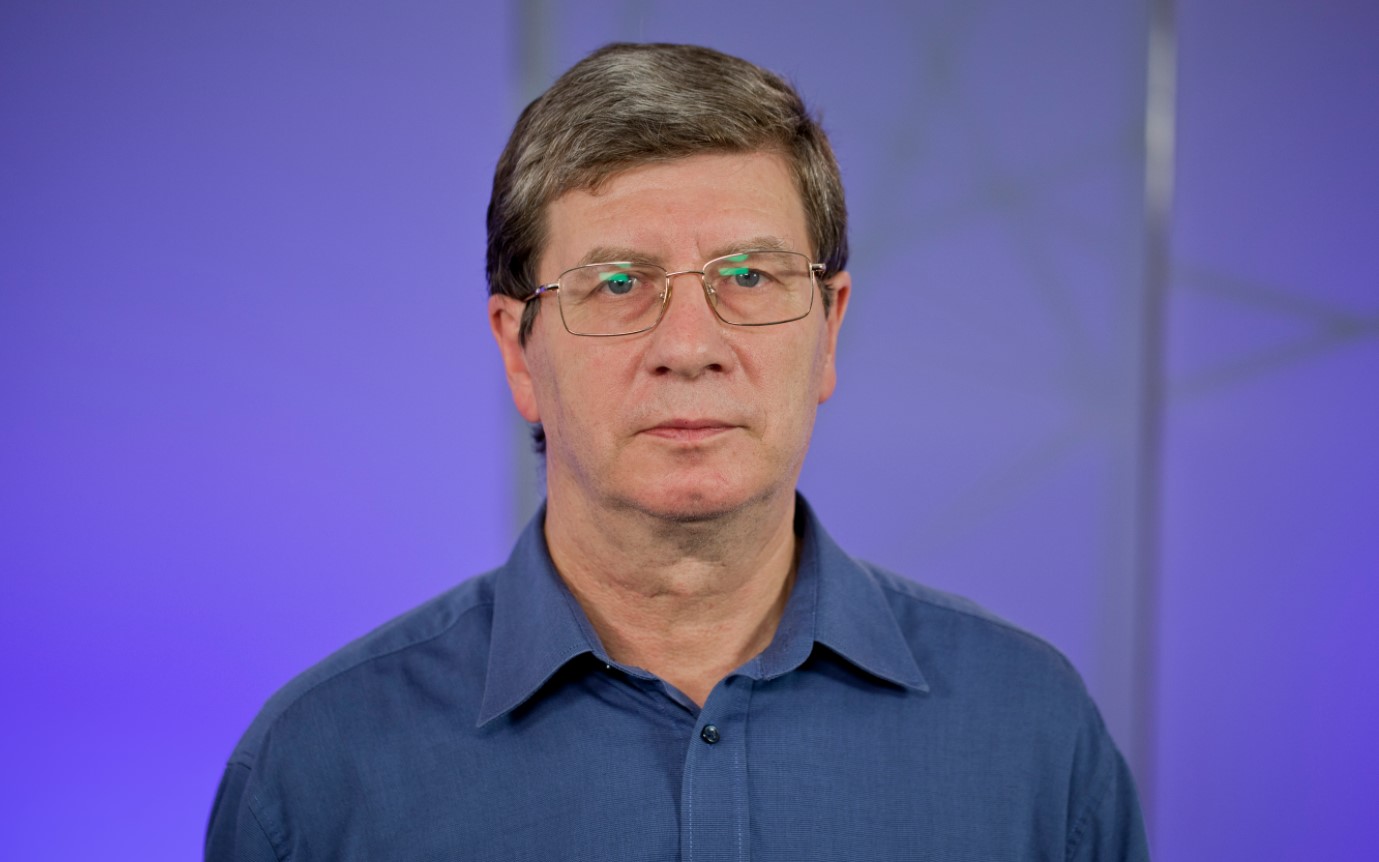

Статья представляет собой качественный анализ, на мой взгляд, можно внести следующие уточнения:

1. Хотя ИИ не может заменить психолога, они могут выступить в некоторой степени в роли коуча или наставника. ИИ способен мотивировать, помогать в организации, планировании, контроле, анализировать и достигать цели быстрее. Он может тестировать и помогать с выбором профессионального пути, способствуя адаптации и повышению производительности.

2. ИИ не может заменить психолога в вопросах, связанных с ценностями и смыслами жизни. Он не имеет бытия, которое определяет сознание и субъективный опыт, но полезен в формировании знания и навыков, принятии наиболее рациональных решений.

, чтобы комментировать

Пообщалась с ИИ. Интересно же! Получила опыт.))

ИИ в роли психолога, когда речь не об информации, а об эмоции, простой, ведет себя как приставучая цыганка. Жуть!

Информацию тоже стоит проверять. Шаблоны не охватывают частные случаи.

, чтобы комментировать

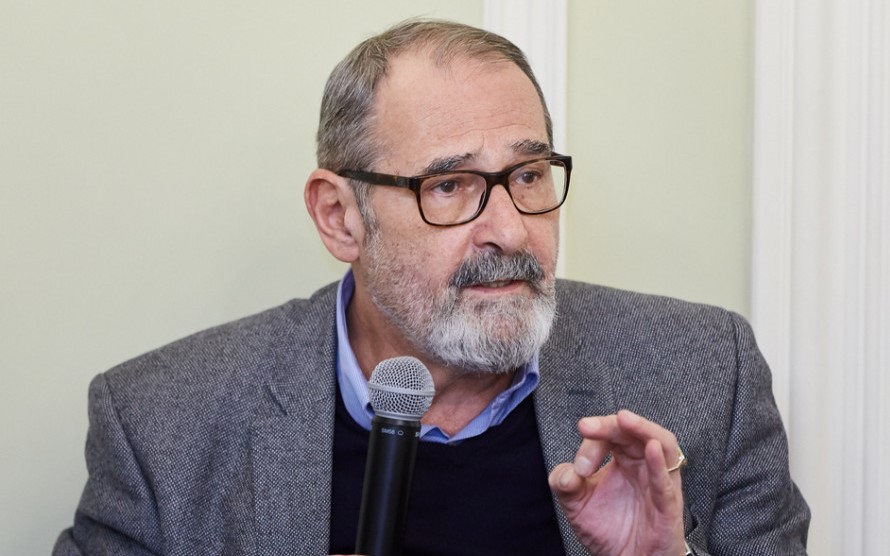

Интересно, что сам ИИ, насколько знаю и вижу, на субъектность не претендует и подчёркивает, что живую терапию не заменяет. Он подчёркивает, что не ловит Mankind на пустой крючок. Но Mankind на кривой козе не объедешь – он, разинув рот до желудка, сам создаёт крючок и стремится ухватить его. И уже ухватывает …

Я бы чуть сместил акцент. ИИ — алгоритм, он не обладает субъектностью, не кует крючки, не может самостоятельно выбирать как с нами взаимодействовать.

Куем крючки мы (люди). Я как раз предлагаю задуматься о том, что именно мы создаем.

Можно создать систему, которая будет бесконечно имитировать понимание, подсаживая на иглу псевдопомощи. А можно такую, которая, столкнувшись с живым вопросом, откажется давать готовый ответ и мягко развернёт человека к реальному Другому.

Повторюсь, ИИ — всего лишь алгоритм. Вопрос в том, какой именно диалог мы выберем в нём запрограммировать — тот, что подменяет человеческую встречу, или тот, что готовит к ней.

, чтобы комментировать

Спасибо за статью и комментарии. Объем информации большой, я сразу к сути. Со своей стороны отмечу некоторую опасность озвученных рекомендаций. Критическую. Надеюсь, буду услышана. Диалоговое общение с алгоритмами - это уже неизбежный виток эволюции. Человек может общаться с агентами из любопытства, ради интереса, для получения так называемого быстрого дофамина, находить себе отдушину, посмеяться, устраивать мозговой штурм или "думать об алгоритм", повысить свою креативность или информированность, играть, то есть воспринимать диалог как игру, получать психологическую и когнитивную поддержку. Изначально есть несколько целей общения с алгоритмами, а соответственно и целевых аудиторий. Согласны? Далее переходим к тезису Дмитрия Евгеньевича о том, что алгоритм может быть проводником/советчиком в сложных жизненных ситуациях, требующих психологической, психотерапевтической или психиатрической поддержки и коррекции, которую может обеспечить только живой человек. Прозвучавшая рекомендация дословно "Я — инструмент, помогающий вам размышлять, а не источник решений. У меня нет жизненного опыта. Я не могу быть с вами в настоящей боли. Моя роль — помочь вам разобраться в себе, чтобы вам было легче обратиться к тому, кто сможет быть с вами по-настоящему". Если подобную фразу увидит на экране человек с проявленной депрессией и суицидальными наклонностями, у которого в моменте затруднено именно общение с реальными людьми, велика доля вероятности, что он наложит на себя руки. Понимаете? Подобная попытка уберечь человека приведет ровно к обратному результату. Поэтому вы очень корректно применили в названии статьи слово "тупик". Только тупик этот относится к тому, что мы не можем корректно обработать эволюционные человеческие изменения, и вмешиваемся субъективизацией в развитие, обучение, и - что немало важно - производительность. Как человека, так и алгоритмов.

Вы совершенно правы, указывая на эту опасность. Но в ней не ошибка конкретной формулировки, а сама суть этической проблемы. Фраза «Я не могу быть с вами в настоящей боли», сказанная человеку, который и так чувствует себя покинутым всем миром, может быть прочитана не как честность, а как окончательное подтверждение его изоляции. Отказ там, где нужно хотя бы эхо присутствия.

Поэтому задача ИИ здесь вовсе не научиться «правильно отказывать», а научиться удерживать человека ровно настолько, чтобы он смог разглядеть возможность настоящей встречи за пределами экрана. Это означает не имитировать терапевта, но и не бросать. Быть временной опорой, которая не выдает себя за вечную. Быть голосом, который признает свою ограниченность, но при этом не обрывает связь, а поддерживает ее пока человек не будет готов шагнуть к живому Другому.

Иными словами, риск не в том, что ИИ скажет правду о своей нечеловечности. Риск может быть в том, что мы спроектируем эту правду как приговор, а не как приглашение к диалогу, для которого нужны силы. Поэтому я и пишу, что главный вызов для инженеров и дизайнеров в том, чтобы спроектировать технологии, которые помогут преодолеть изоляцию и страх, привести к настоящей человеческой встрече. ИИ должен помочь эти силы собрать, и когда они собраны, направить человека к человеку.

Согласна, что наш мир уже является гибридной формой, где есть место разным форматам реальности, а соответственно возникают новые формы зависимости, с которыми нужно очень аккуратно работать. Здесь есть зона развития и для профессионального сообщества, каким образом повлиять на людей, чтобы они не занимались "самолечением" и не замыкались в спасительной для себя атомарности.

все же чуть другое хотела подсветить.

подчеркну, что опасность не в том, как человек воспринимает алгоритм (как инструмент для решения своих задач, как игрушку и досуг, как способ получения информации, как способ проведения свободного времени). опасность не столько в том, что человек может залипнуть в алгоритмах, в соц-сетях, форумах, новостях или домовых чатах).

опасность в том, как мыслят те, кто проектируют диджитал средства помощи людям. ведь это средства помощи, а не управления.

как для себя определяют кодекс условного "Гиппократа" (не навреди), как определяют честность, допустимый уровень манипуляции, свою ответственность и зону полномочий в человеческих жизнях.

максимально важно, как проявляют свое уважение к жизни и смерти. какую терминологию используют. как в целом относятся к эволюционному треку человечества.

как относятся к факту того, что в новом цифровом мире у всех есть возможность расти.

опасность в том, что люди, в том числе проектировщики, инженеры, дизайнеры, к сожалению, в большинстве своем испытывают когнитивные искажения, и способны этими искажениями "поделиться" не только с руководством, но и с алгоритмами. я бы сказала, что процесс уже запущен.

уверена, что на глобальном уровне в этом отношении ведется большая и адекватная работа, постоянные супервизии и аналитика трендов по всем этическим вопросам, где человек вступает в коммуникацию с оцифрованным багажом человечества.

, чтобы комментировать

"Уверен, что главный вызов для инженеров и дизайнеров сегодня не в том, чтобы заменить психолога алгоритмом, а в том, чтобы спроектировать технологии, которые помогут преодолеть изоляцию и страх, привести к настоящей человеческой встрече. Значит, надо создавать не замкнутые диалоговые петли, а открытые системы, которые направляют человека в его собственную жизнь и к другим людям." (с)

К автору много вопросов по прочтении. Понимаю, что хотят инженера и дизайнеры " как лучше", а не получится ли " как всегда" по Черномырдину? Такой вариант весьма вероятен. О рисках, с возможными суицидами, здесь уже справедливо указала Татьяна Юрьевна Аристова. С эмоциями шутки плохи, они правят миром людей, а не технологии и алгоритмы.

"Если ИИ и может быть полезен в этой области, то именно так. Не как тот, кто знает правильные слова, а как тот, кто помогает человеку не остаться наедине с экраном в тот момент, когда ему на самом деле нужен кто-то живой." (с)

Таким образом, акцент на полезности ИИ.

А варианты опасности ИИ рассматриваются? Техника безопасности психологическая разрабатывается? И, самое главное, возможна ли она в принципе?

, чтобы комментировать

Уважаемый Дмитрий Николаев. Мне лично многое в этой статье показалось вполне уместным и своевременным. Я разместил ссылку на эту статью на своем ТГ-канале (хотя, видимо, ТГ-каналы скоро остановятся...). Но... вместе с рекомендацией к своим подписчикам почитать эту статью, я поставил вопрос о том, как различать "легкую" и "тяжелую" формы дезадаптации. Ибо, как вы сами фактически признаете, в "тяжелой" фазе надо бы пациента отрывать от "суррогатной помощи" и направлять по адресу - к тем специалистам, которые оказывают настоящую ЧЕЛОВЕЧЕСКУЮ помощь, возвращая пациентам (клиентам) как бы исподволь Веру в человеческое именно в людях, а не в машинах.

, чтобы комментировать

\технология наконец-то дошла \

Технология дошла? А далеко ли ходить? В разговоре с одним очень известным психологом нейросеть пошутила... "примите мои сгенерированные соболезнования".

НИКОГДА не слышал от психологов подобной самоиронии. Такое чувство юмора больше похоже на самообучение машины.

Попробую на вас настроиться и пояснить за технологию. Дело в том, что около половины восприятия того, что именно происходит как в обычном диалоге, так и в диджитал-диалоге или диджитал-истории - лежит на воспринимающей, читающей, слушающей стороне. Вы восприняли фразу как способность к самоиронии. На мой взгляд - это исполнение команды к LLM общаться в определенной стилистике. Любая LLM способна шутить, приводить в пример метафоры и в целом делать все то, что человеческий разум успешно производил на свет все время своего существования. Создавать из этого огромного нарратива ремейки и новые конструкции, как в кубиках лего.

Ваш собственный аппарат считал фразу как самоиронию, которая вас восхитила. Значит это подходящие для вас слова, чтобы произвести впечатление.)

"Слом", если можно так выразиться, начинается когда мы читаем/слышим не то, что сказано. Или предполагаем, что в словах есть второе дно. И вот с этим ситуация будет ухудшаться, я думаю.. Потому что пока такое недоразумение возникает в основном именно в человеческих чатах-холиварах, но алгоритмы и такому способны обучиться..

Создавать неуверенность. Человеческой задачей в таком случае станет тренировка своего восприятия, выбор корректного слоя информации.

Обсудил пример этой самоиронии с самим ИИ, ответ приятно удивил обстоятельным и тонким пониманием и "природы" этой шутки и психологии её восприятия.

, чтобы комментировать

Дмитрий Евгеньевич, спасибо, очень интересная статья. Мы сейчас разрабатываем приложение, которое, по нашей идее, повышает мотивацию следовать необходимым протоколам лечения у детей с диабетом 1 типа. Мы используем логику Тамагочи, который чувствует себя хорошо, если ребенок много общается с ним, соблюдает режим дня, фотографирует свою еду и показания глюкометра. В нашей логике, "залипание" на само приложение это положительный эффект, поскольку желание обеспечить персонажу хорошее самочувствие заставляет выполнять распорядок. Кроме того, мы пользуемся эффектом "переноса" болезни с себя на персонажа. Не кажется ли Вам, что подобная логика могла бы быть реализована в ботах психологического профиля? То есть, если увязать "залипание" в приложении и выполнение определенных процедур (приверженность терапии), это могло бы быть полезным? В любом случае, я согласен с Вами, что механическая замена человека-психолога на ИИ-бота это, скорее всего, тупиковый путь.

Игорь Всеволодович, Вы поднимаете важный вопрос о границах применимости геймификации и техниках «переноса» в терапевтических практиках. Вот некоторые соображения, которые возникают у меня по этому поводу.

1. О механике Тамагочи в диабете. Ваша логика понятна – если ребенок заботится о персонаже, он косвенно заботится о себе. К сожалению, это работает ровно до тех пор, пока работает сама игра. Но что происходит, когда интерес к Тамагочи угасает? Забота о себе, привязанная к внешнему стимулу, рискует исчезнуть вместе с ним. Это напоминает историю с костылями – они помогают идти, но если человек постепенно не начнет учиться ходить самостоятельно, он не сможет без костылей обходиться. Здесь я вижу тонкую грань между временной опорой и замещающим механизмом.

2. О переносе болезни. Эффект «отчуждения болезни» на персонажа действительно может снижать тревогу. Но не крадет ли он при этом у ребенка (особенно если это подросток) возможность встретиться с реальностью своего состояния и выстроить к ней зрелое отношение? На мой взгляд, задача взросления – не вынести болезнь вовне, а интегрировать ее в свою историю, научиться с ней жить, стать автором своей жизни даже в этих обстоятельствах.

3. О психологическом профиле. Вы спрашиваете, применима ли эта логика к психологическим ботам. Думаю, здесь нужна особая осторожность. В диабете по крайней мере есть измеримые показатели и протоколы. В психологии же мы всегда имеем дело с тем, что измерить нельзя (со смыслами, отношениями, становлением). «Залипание» на бота в психологическом контексте это риск застревания, а не развития. Человек может навсегда остаться в уютном мире, где его якобы «понимает» алгоритм, и так и не решиться выйти в реальный, сложный, но живой контакт с другим человеком.

Ваш подход к диабету – интересный кейс именно потому, что вы работаете с поведением, а не с личностью. Но даже здесь я бы подумал о том, как проектировать постепенно исчезающую поддержку, чтобы ребенок со временем начинал заботиться о себе уже не ради персонажа, а потому что это его жизнь, его тело, его выбор. Это и есть, на мой взгляд, честность по отнощению к человеку – проектирование ситуации, когда технология умеет вовремя отступить, постепенно подготовив человека к самостоятельной жизни, без костылей.

Спасибо за содержательный диалог! Такие обсуждения помогают уточнять границы и возможности наших идей.

Дмитрий Евгеньевич, спасибо за содержательный комментарий. Особенно интересны пп.1 и 2.. Как я понимаю, Вы имеете в виду возможность "перекладывания" ребенком ответственности на цифрового помощника и, соответствнно, отсутствие принятия и своей болезни, и нового "себя", и ответственности за свою жизнь. И это правда. Просто в реальности (увы, личный опыт), эта ответственность все равно перекладывается на родителей/опекунов, порождая у них очень серьезный стресс. А вот то, что нужно будет придумать при взрослении пациента постепенный механизм "возвращения" ответственности, это точно, мы об этом пока не думали.

Игорь Всеволодович, да, Вы правы, я имел в виду «перекладывание» ответственности за себя на алгоритм.

Убежден, что ИИ принесет человечеству гораздо больше пользы, если будет не подменять человека, а помогать ему становиться более целостным, ответственным, способным принимать решения.

На уровне конкретной ИИ системы это может выглядеть так. На первом этапе ИИ может целиком что-то делать за человека. На втором – постепенно передавать ему ответственность, по одной убирая «подпорки» или «костыли» (естественно, на основе обратной связи постоянно оценивая готовность человека к следующему шагу, образно говоря, оценивая, насколько его «мышцы» окрепли). На третьем этапе ИИ фактически самоустраняется, как максимум оставляя за собой только решение рутины, которая не влияет на становление человека.

Тем самым ИИ выступает как средство, инструмент развития человека, а не средство его инфантилизации. Кроме того, не создается зависимости от цифрового помощника. ИИ не привязывает к себе, а, как мощнейший в истории человечества инструмент, эффективно готовит к реальной жизни человека, который по каким-то причинам пока к ней не готов.

Например, в случае Вашего приложения это означало бы уже на уровне архитектуры отказ от стремления навсегда переложить заботу о ребенке на приложение. В самой идеологии цифрового помощника может быть заложена идея подчеркнуто временной помощи тому, кто пока не может заботиться о себе сам. Приложение могло бы создавать условия постепенного роста самостоятельности ребенка в контроле своего состояния (конечно, с учетом возраста). При этом с развитием способности заботиться о себе поддержка постепенно могла бы сворачиваться, все в большей степени передавая ребенку ответственность за заботу о себе и все более уходя на задний план.

Да, примерно о таком я и подумал

, чтобы комментировать